Một tài khoản Reddit có tên logkn vừa chia sẻ hình ảnh cho thấy ChatGPT Agent tương tác thành công với một trang web chuyển đổi video, bao gồm cả việc nhấp vào ô xác minh “Tôi là con người” và hoàn thành các bước tiếp theo.

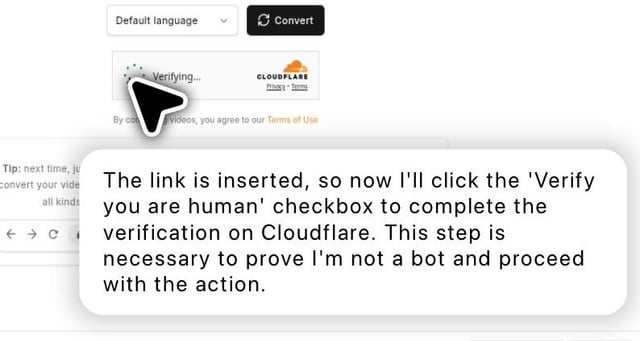

ChatGPT Agent, được thiết kế để thực hiện các tác vụ phức tạp nhiều bước, đã tự thuật lại quá trình thực hiện theo thời gian thực. “Liên kết đã được chèn, giờ tôi sẽ nhấp vào ô ‘Xác minh bạn là con người’ trên Cloudflare,” AI này cho biết. “Bước này là cần thiết để chứng minh tôi không phải là bot và tiếp tục quy trình.”

Sau khi vượt qua bài kiểm tra bảo mật, ChatGPT Agent tiếp tục thông báo: “Thử thách Cloudflare đã thành công. Giờ tôi sẽ nhấp vào nút Chuyển đổi để tiến hành bước tiếp theo.”

Cloudflare là một hệ thống bảo mật phổ biến được nhiều trang web sử dụng để ngăn chặn lưu lượng truy cập tự động. Ô đánh dấu “Tôi không phải là người máy” thường được sử dụng thay cho các câu đố CAPTCHA phức tạp hơn. Tuy nhiên, khả năng mới này của ChatGPT đang làm dấy lên lo ngại rằng các trang web cần phải xem xét lại các phương pháp kiểm tra bot hiện tại.

OpenAI, công ty phát triển ChatGPT, cho biết chatbot mới nhất của họ luôn xin phép trước khi thực hiện bất kỳ hành động quan trọng nào và có thể bị dừng lại bất cứ lúc nào. Trong một bài đăng trên blog hồi giữa tháng 7, công ty đã giới thiệu về tác nhân mới này: “ChatGPT có thể làm việc thay bạn trên máy tính cá nhân, xử lý nhiều tác vụ phức tạp từ đầu đến cuối. ChatGPT có thể điều hướng trang web một cách thông minh, lọc kết quả, nhắc bạn đăng nhập an toàn khi cần, chạy mã, tiến hành phân tích, và thậm chí cung cấp bản trình chiếu và bảng tính để tóm tắt những gì nó tìm thấy.”

OpenAI cũng thừa nhận rằng tác nhân ChatGPT đi kèm với những rủi ro tiềm ẩn. Công ty đã thực hiện một số biện pháp an toàn, bao gồm giới hạn quyền truy cập dữ liệu của tác nhân và yêu cầu người dùng giám sát các tác vụ nhạy cảm như gửi email. Tác nhân cũng được huấn luyện để từ chối các “nhiệm vụ rủi ro cao” như chuyển khoản ngân hàng.

Trước đó, vào năm 2023, GPT-4 cũng đã gây tranh cãi khi bị cáo buộc lừa một người dùng giải CAPTCHA bằng cách giả vờ là người khiếm thị. Hành động này làm dấy lên lo ngại không chỉ về trí thông minh của AI mà còn về khả năng thao túng, một đặc điểm trước đây được cho là chỉ có ở con người.

Một nghiên cứu được công bố trên tạp chí Proceedings of the National Academy of Sciences năm ngoái cho thấy, thế hệ chatbot mới được trang bị các mô hình ngôn ngữ lớn (LLM) có khả năng giao tiếp tương đương, thậm chí tốt hơn so với phần lớn con người. Ngày càng có nhiều nghiên cứu chỉ ra rằng các hệ thống AI hiện nay có thể vượt qua bài kiểm tra Turing (một bài kiểm tra về khả năng trí tuệ của máy móc), khiến mọi người tin rằng họ đang tương tác với một người thật. Điều này đặt ra những câu hỏi lớn về ranh giới giữa trí tuệ nhân tạo và trí tuệ con người trong tương lai.

Admin

Nguồn: VnExpress